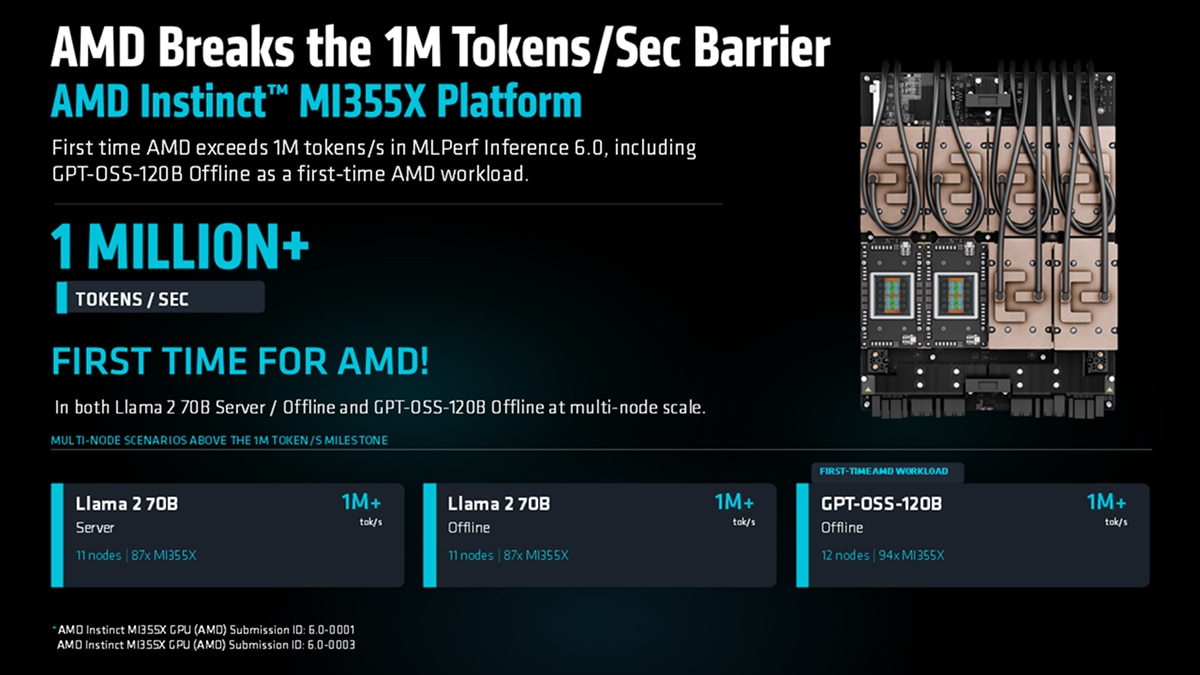

AMD ultrapassa 1 milhão de tokens por segundo no MLPerf 6.0 e reforça competitividade em IA generativa

A AMD anunciou resultados expressivos na edição 6.0 do MLPerf Inference, um dos principais benchmarks globais de desempenho em inteligência artificial. A empresa destacou que suas GPUs da linha Instinct MI355X ultrapassaram a marca de 1 milhão de tokens por segundo em inferência distribuída, consolidando avanços relevantes em desempenho, escalabilidade e maturidade de sua plataforma para IA generativa.

O anúncio não se limitou à apresentação de números. A companhia buscou demonstrar a evolução de sua infraestrutura completa, incluindo hardware, software e ecossistema de parceiros, como resposta às novas demandas do mercado por soluções de inferência mais robustas e escaláveis.

Avanços além do desempenho bruto

Segundo a empresa, os resultados obtidos no MLPerf Inference 6.0 representam mais do que uma melhoria incremental de desempenho. A proposta foi evidenciar a capacidade de lidar com cargas de trabalho inéditas, garantir escalabilidade em ambientes multinó e assegurar reprodutibilidade em sistemas operados por parceiros.

Esse conjunto de fatores reflete uma mudança na forma como clientes avaliam plataformas de IA. Além da performance em um único servidor, passam a ser considerados aspectos como tempo de inicialização de modelos, eficiência em escala e consistência dos resultados em diferentes ambientes.

Arquitetura voltada para inferência em larga escala

As GPUs Instinct MI355X foram desenvolvidas com base na arquitetura CDNA 4, utilizando processo de fabricação de 3 nanômetros e incorporando aproximadamente 185 bilhões de transistores. O modelo oferece suporte a novos formatos de precisão, como FP4 e FP6, além de até 288 GB de memória HBM3E.

Com capacidade de atingir até 10 petaflops nesses formatos de precisão, a plataforma permite a execução de modelos com até 520 bilhões de parâmetros em uma única GPU. A proposta é atender não apenas à necessidade de alto desempenho, mas também à execução de modelos cada vez mais complexos em ambientes de produção.

Marco histórico em inferência de IA

Um dos principais destaques da submissão foi a superação da marca de 1 milhão de tokens por segundo em inferência. O resultado foi alcançado em testes com modelos como Llama 2 70B e GPT-OSS-120B, em configurações multinó.

Esse marco indica que a infraestrutura está preparada para aplicações em escala de produção, nas quais a taxa de processamento e o tempo de resposta são fatores críticos. A capacidade de manter desempenho elevado mesmo em ambientes distribuídos reforça a viabilidade da plataforma para grandes implementações.

Evolução significativa em relação à geração anterior

Os testes também demonstraram um salto de desempenho em relação à geração anterior de GPUs da empresa. Em um cenário com o modelo Llama 2 70B, a MI355X alcançou mais de 100 mil tokens por segundo em um único servidor, representando um aumento superior a três vezes em comparação com a geração anterior.

Esse avanço é atribuído à combinação de melhorias na arquitetura, maior densidade computacional, novos formatos de precisão e otimizações no software.

Competitividade em benchmarks de referência

Nos testes comparativos com soluções concorrentes, as GPUs da AMD apresentaram desempenho competitivo em diferentes cenários, incluindo processamento offline, execução em servidores e aplicações interativas.

A consistência dos resultados em múltiplos modos de operação foi destacada como um diferencial, indicando que a plataforma é capaz de atender a diferentes tipos de carga de trabalho sem comprometer a eficiência.

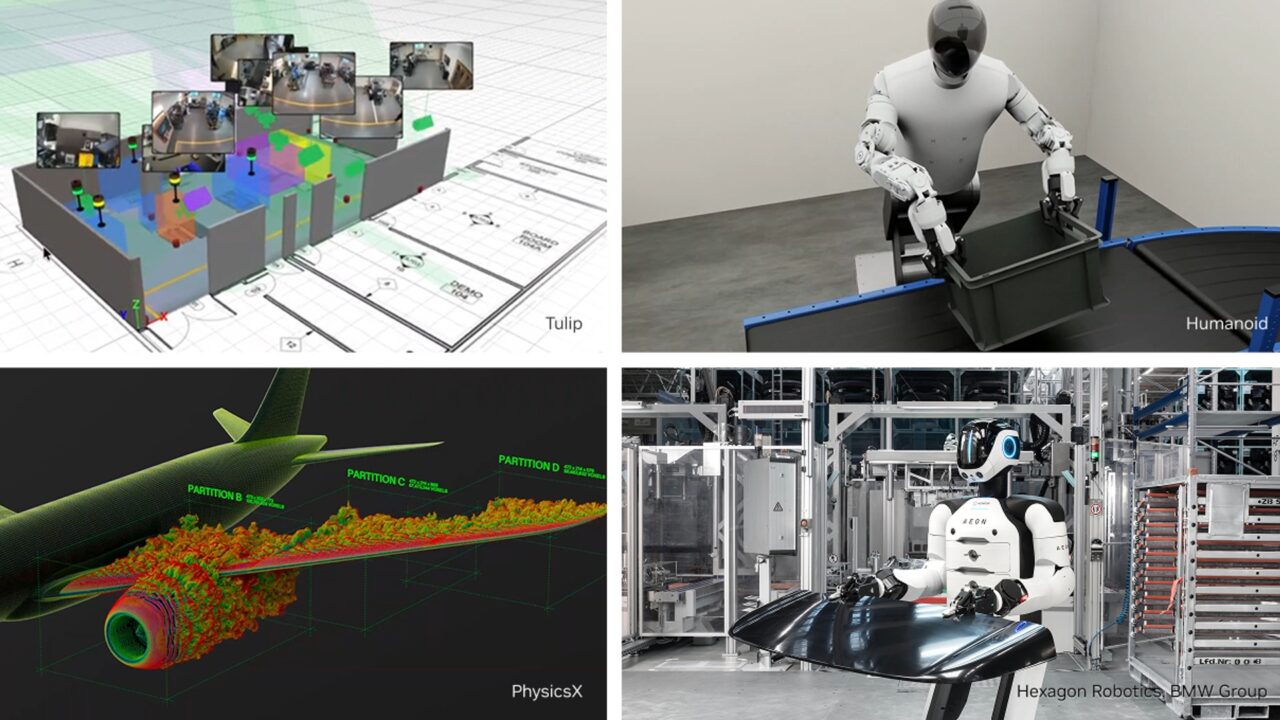

Expansão para novas categorias de IA

Outro ponto relevante foi a inclusão de cargas de trabalho inéditas no benchmark, como o modelo GPT-OSS-120B e aplicações de geração de vídeo a partir de texto.

No caso do modelo Wan-2.2-t2v, voltado para criação de vídeo, os resultados demonstraram que a empresa já está preparada para lidar com aplicações multimodais, que combinam diferentes tipos de dados e exigem maior capacidade computacional.

Essa expansão reflete a evolução da inteligência artificial generativa, que vem incorporando novos formatos além do texto, como imagem, áudio e vídeo.

Escalabilidade em múltiplos nós

A capacidade de escalar aplicações em ambientes distribuídos foi outro destaque da apresentação. Em testes com múltiplos nós, a plataforma manteve eficiência próxima ao ideal, mesmo com o aumento do número de GPUs.

Em uma configuração com dezenas de unidades, a empresa conseguiu manter altos níveis de desempenho com baixa perda de eficiência, o que é essencial para aplicações em larga escala.

Essa característica é considerada fundamental para a evolução de infraestruturas de IA, que tendem a operar em clusters cada vez maiores.

Ecossistema e reprodutibilidade

A AMD também enfatizou a participação de parceiros na validação dos resultados. Empresas como Dell Technologies, Cisco e HPE realizaram submissões utilizando diferentes configurações de hardware, demonstrando consistência nos resultados.

A variação de desempenho entre os sistemas foi mínima, o que indica que os números apresentados podem ser reproduzidos em ambientes reais, reduzindo riscos para empresas que pretendem adotar a tecnologia.

Inferência heterogênea e distribuição geográfica

Um dos experimentos apresentados envolveu a utilização de diferentes gerações de GPUs em uma mesma infraestrutura, operando em locais distintos. A configuração demonstrou que é possível combinar equipamentos variados e distribuídos geograficamente sem comprometer o desempenho.

Esse tipo de abordagem permite que empresas aproveitem infraestruturas já existentes, reduzindo custos e aumentando a flexibilidade operacional.

Papel do software na evolução da plataforma

O software ROCm, desenvolvido pela AMD, foi apontado como elemento central para os resultados alcançados. A plataforma permite otimizar o uso do hardware, melhorar a comunicação entre GPUs e facilitar a execução de modelos complexos.

Além disso, o sistema contribui para a rápida adaptação a novos modelos e cargas de trabalho, um fator cada vez mais importante diante da velocidade de evolução da inteligência artificial.

Perspectivas para o futuro

Os resultados apresentados fazem parte de uma estratégia mais ampla da empresa, que inclui atualizações anuais em sua linha de GPUs e o desenvolvimento de soluções em escala de rack para aplicações de grande porte.

A próxima geração, baseada na arquitetura CDNA 5, deve ampliar ainda mais a capacidade de processamento e consolidar a posição da empresa no mercado de infraestrutura para IA.

Conclusão

A participação da AMD no MLPerf Inference 6.0 evidencia um avanço significativo em sua estratégia para inteligência artificial generativa. Ao combinar desempenho elevado, escalabilidade eficiente e um ecossistema consolidado, a empresa busca se posicionar como uma alternativa competitiva no mercado dominado por grandes fornecedores de hardware.

Os resultados indicam que a disputa por liderança em infraestrutura de IA tende a se intensificar, com foco não apenas em desempenho, mas também em flexibilidade, custo e capacidade de adaptação às novas demandas do setor.

Comentarios (0)